五项可能会改变未来的电影技术导演/编导

未来怎么拍电影没人知道。

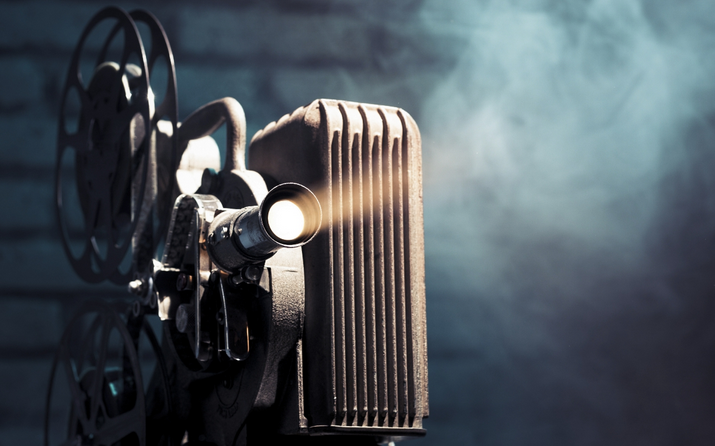

1895年卢米埃尔兄弟在巴黎的“大咖啡馆”放映了《火车到站》,标志电影的正式诞生。此后电影慢慢有了色彩、声音,接着又变成了数字化以及出现了3D技术。这中间出现了D·W·格里菲斯,奥逊·威尔斯、希区柯克、库布里克、卡梅隆、诺兰....等等,这些电影人告诉我们什么是好的电影,或者改变着电影讲述故事的方式。现在是2016年,能够播放电影的媒介越来越多,也越来越方便,形式的变化,快的有些惊人,但这5项技术,或许能让我们一窥电影的未来。

原文地址:http://www.premiumbeat.com/blog/six-technologies-poised-to-change-the-future-of-film/ 翻译、编辑:cherry

1.光场技术

首先来科普一下光场(Light Field)到底是什么鬼?

光场是指在每一个方向照来的每束光线,配备了光场技术的镜头,可以同时捕捉到整个背景的光场,拍摄的照片可以随意改变焦点,移动视角,相当于捕捉了某个瞬间的全部影像。

更通俗的说,用普通全景相机拍摄的影像我们只有“站在”一个点上才能看清图像,而光场相机的影像由于能改变焦点,我们在虚拟世界中移动时,图像也会随之变化,感受起来就像在一个真实的世界中行走。

2012年Lytro所出的新相机——ILLUM,是世界上首个可以消费级别的光场相机。当你用ILLUM来拍照时,只需先构图,之后再决定焦点。去年 11 月 Lytro 推出的 Lytro Immerge VR 摄像设备也运用了类似的技术,使操作者可以调整自主调节视频的视角,随时从 360 度调整为 180 度或者 270 度,使拍摄方式更加自由多样。

还有Lytro Cinema摄像机,它可以拍摄出像素高达7.55亿、帧率为每秒300帧的RAW影像。它的特别之处是:通过捕捉进入镜头的所有光线的详细深度和方向信息,这部摄像机可以实现目前只能依靠CG才能做到的特殊效果。它可以捕捉一个场景中的所有3D模型,而不是传统的2D画面,利用CG,Lytro Cinema所拍摄的图像可以很容易地被编辑或者加上特效。Cinema 除了可以让摄影师在拍摄后才调整视频的对焦点,现在还可以调整景深、最高 16 级的动态范围和快门速度呢!换句话说,就是导演可以不需要因为拍摄的问题而重拍整个场景,只要通过后制即可。制成品更可以因应播放媒介,如电视或 IMAX 而选择其帧数和格式。

2.平面透镜

哈佛大学工程与应用科学学院的研究团队首次制作出超薄平面透镜,能够在可见光谱中有效的工作。这个独特的透镜或许会掀起一场光学革命。

这款透镜的特色在于由二氧化钛创建出来的纳米结构表面,具有高数值的孔径,使入射光精确聚焦于一点上。论文的第一作者Mohammadreza Khorasaninejad解释说:“越能有效聚焦,聚焦斑就越小,这可以有效提高图像分辨率。”同时,这种平面、超薄的透镜理论上可以通过更广范围的波长去提供高精确度,减少色差(通常因为凸面透镜带来的问题)。目前各种装置内的光学组件体积都相当大,原因是光束必须藉由通过不同厚度的透镜来改变形状,而平面透镜的新技术可能会重构关于相机的想象。

3.苹果7的双镜头相机

苹果7并不是第一个运用双镜头的手机,但它很有可能是最棒的。

据科技网站MacRumors报道,苹果申请的一项专利使外界有机会了解它对未来iOS设备上双镜头相机界面的设想。除了当前iPhone标配的广角镜头之外,文件中还描述了另一颗可以拍摄放大的视频和照片的副摄像头。

此前的专利申请材料显示,在相机应用中,两个镜头拍摄的图像可以通过分屏方式显示在同一画面,一侧显示标准广角图像,另一侧显示长焦镜头拍摄的图像。Apple对LinX Imaging相机技术公司的高价收购让iphone拥有可以媲美数码单反拍摄效果的技术。

在拍摄照片时,用户能在两个镜头间无缝切换,点击图像中的某一处即可通过第二个镜头对图像进行放大。苹果这一系统的原理与目前的数字变焦技术相似,但由于利用长焦距镜头而非软件放大图像,图像细节不会因此受损,放大后的图像更锐利、清晰。

两个相机都用来拍摄视频(甚至是慢动作视频),或者一个镜头用于拍摄视频、另一个用于拍摄照片,生成的文件可以单独存储,也可以通过苹果软件融合在一起。但是此前也有小道消息称,“iPhone 7双摄像头由于技术不成熟被取消.”

4. 计算机化的拟音

麻省理工学院的研究员研究出了一种电脑系统,可以独立地把现实的声音加进寂静的视频。虽然这项技术仍在初期阶段,但是这向电影音效的自动化跨了一大步。

这一系列视频都是鼓槌去敲击一些东西,包括人行道、草、金属表面,电脑学习去匹配合适的音效,比如鼓槌敲击一片木板或者沙沙作响的树叶。通过深度学习,电脑系统学习去识别大量数据的模式,以及如何有效地运用。

MIT计算机人工智能的研究员录制了大概1000个视频,关于用鼓槌敲打真实世界的物体,让电脑去学习不同动作和表面所产生的声音。当电脑学习了这些案例后,研究员给了鼓槌敲打物体的无声视频,并让其匹配合适的声音。

5. AI写剧本

纽约大学AI研究员Ross Goodwin与导演Oscar Sharp创造了Benjamin——一个自我命名的递归神经网络,当“被迫”看了大量的科幻电影作为素材,写出了剧本,就是看起来有点奇怪。(谢天谢地,看来Benjamin占领好莱坞还需要一段时间)

这5项其实主要比较冷门,离成熟还有些遥远,像VR、CG其实有了非常快速的发展,比如说:CG完全可以重现一个已经消失了的人。VR未来还有着更多的可能性,现在它已经被资本炒的火热。技术的变化推动着电影的变化,关于未来,总是惊喜吧!如果你认为我漏掉了好的技术,下面留言呗。

1914篇文章